美光G9 NAND技术重磅发布!旗舰手机性能再攀巅峰

在快节奏的今天,手机早已不是单纯的通讯工具,随着AI技术的不断发展,智能手机正在成为人类的AI助手。这背后,都依赖大容量高速存储系统!这一趋势将进一步推动边缘设备对内存和存储的需求。

在2025年巴塞罗那世界移动通信大会(MWC25)上,美光亮出大招:宣布正在送样业界首款基于 G9 NAND的移动UFS 4.1和UFS 3.1产品。

G9节点是美光的新一代创新型NAND技术,旨在为旗下所有存储解决方案带来前所未有的性能和密度优势。 G9对新一代移动通用闪存(UFS)移动产品到底有多强?一文揭秘!

G9 NAND UFS 4.1:性能直接拉满

美光G9 NAND移动UFS 4.1解决方案可为旗舰智能手机带来业界前沿的性能和创新,从而实现更快速、更灵敏的使用体验。

速度更快、延迟更低:

想象一下,手机中的虚拟助手能够充分理解您的指令,您还可以使用手机快速进行实时图片编辑,并在瞬间完成语言翻译。这些都是未来基于大语言模型(LLM)的AI应用,它们将彻底改变智能手机用户的数字体验。

最终,这些服务将融合成功能强大的多模态AI代理,为用户提供快速、全面且具备情境感知能力的数字体验。为实现这一目标,智能手机需要快速访问海量数据集、降低延迟、提高响应速度,从而实现更流畅的终端用户体验。

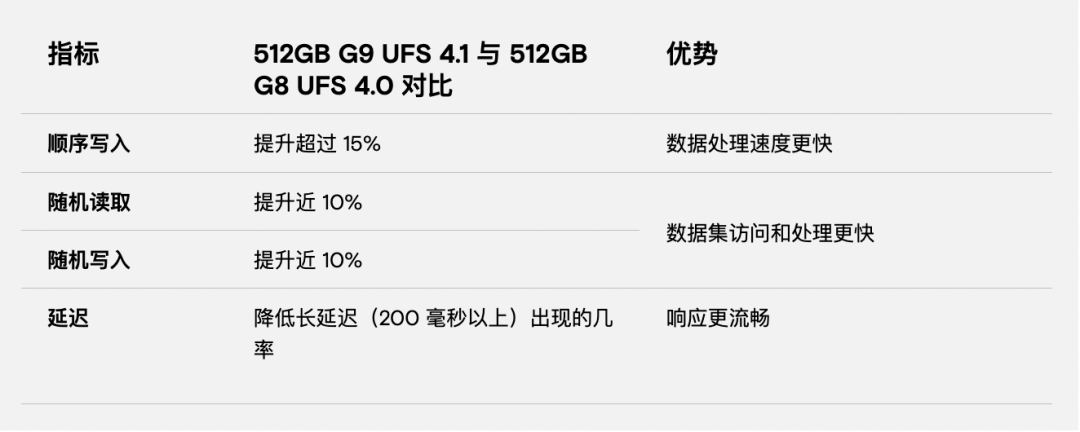

凭借超过4100MBps的顺序读写速度,美光G9 NAND移动UFS 4.1正在引领这一变革趋势。与上一代G8 UFS 4.0进行比较后,我们能清楚地看到G9 UFS 4.1带来的性能飞跃。

512GB G9 UFS 4.1与512GB G8 UFS 4.0对比

容量更大:

更大的存储容量是提升本地计算和处理能力的因素之一。传统的云端AI系统需要将敏感数据通过网络传输后进行处理,存在数据泄露风险。边缘AI可在本地处理生成的数据,从根本上降低了上述风险。

美光G9 UFS 4.1支持高达1TB的NAND大容量存储,可满足设备端处理大量数据的需求,让您的智能手机轻松处理复杂的计算任务。

封装更小更薄:

美光G9 NAND UFS 4.1不仅提高了容量,其更小更薄的外形可支持更具时尚感的创新智能手机设计。

美光G9 NAND UFS 4.1采用业界前沿封装技术,1TB NAND UFS的封装尺寸仅有9x13x0.85毫米大小(与上一代G8 UFS 4.0相比),可大幅节省手机内部空间,是下一代可折叠以及超薄智能手机设计的理想之选,其节约的空间可用于搭载更大容量的电池。

专有功能优化:

1. 数据碎片整理:

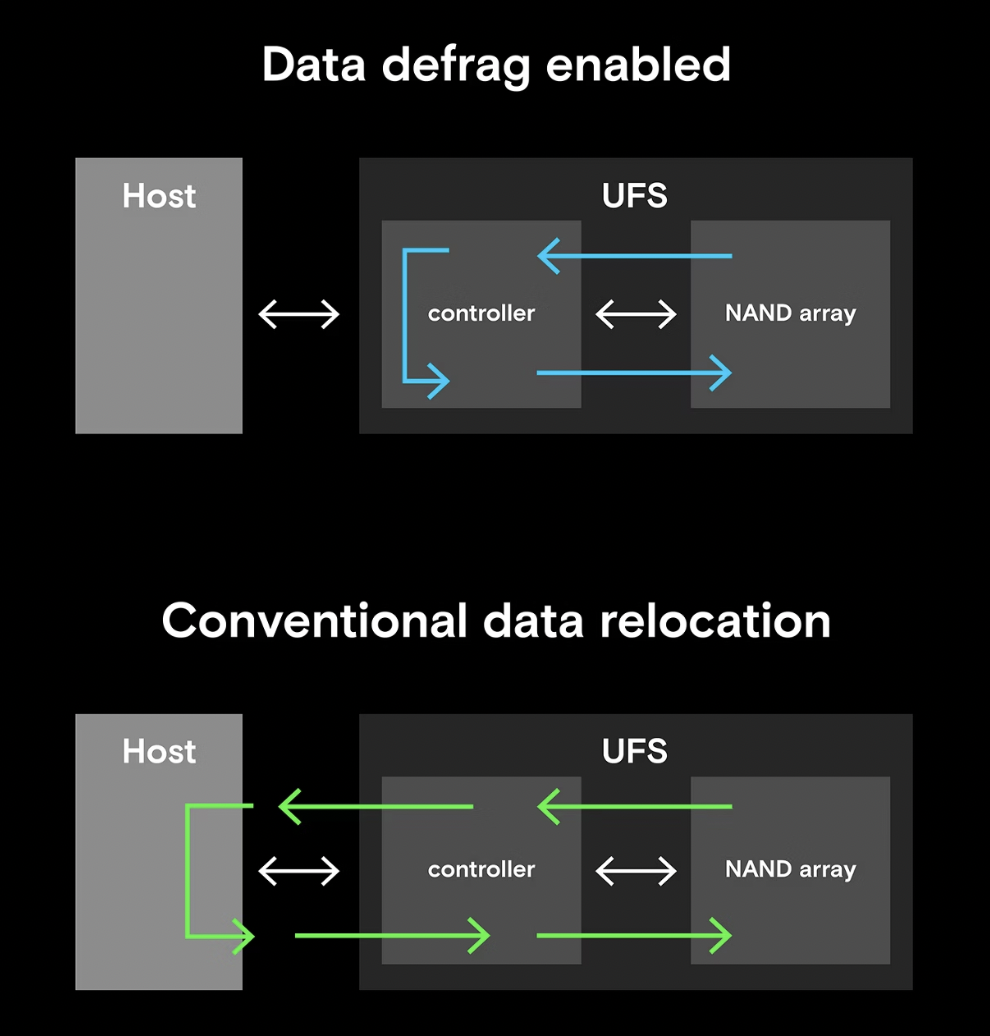

智能手机的运行速度逐渐变慢,通常是由于数据碎片化—文件分散存储在各个地方,导致存储设备难以实现高效读取。

美光专有的数据碎片整理功能可解决这一问题,它支持UFS设备的控制器绕过主机层,直接在NAND内部发出碎片整理命令。通过简化数据迁移过程,数据碎片整理功能可将读取速度提升高达60%(启用数据碎片整理与未启用数据碎片整理的对比),从而提升智能手机的整体性能,包括日常任务和 AI 相关任务。

简言之,数据碎片整理功能通过在内部处理数据迁移/碎片整理,提高读取性能并降低设备的负荷,使智能手机能够更快、更高效地访问文件,实现更流畅的使用体验。

2. 增强型WriteBooster:

借助美光的增强型WriteBooster功能,智能手机处理器可将常用数据“固定”在存储设备内部名为“WriteBooster”的指定区域内。

利用该功能,处理器可以更轻松地将重要数据从存储设备动态加载到内存,确保处理过程更加高效,不会面临内存容量不足问题。

内部测试数据表明,启用此功能后,随机读取速度可提高多达30%(启用增强型WriteBooster与未启用增强型WriteBooster的对比)。

增强型WriteBooster功能可加速智能手机的应用启动速度、文件传输速度,让用户操作更加流畅。当用户需要同时使用日常应用和 AI 应用时,此功能尤为有用。

在这种使用场景下,可利用增强型WriteBooster功能为AI模型的数据创建内存映射,从而实现更快的数据交换和读取。

未固定的数据将从缓存缓冲区移至普通存储区域

3. 智能延迟跟踪器(ILT):

美光的智能延迟跟踪器可监控系统和存储设备上的I/O存储延迟,以检测和分析影响智能手机性能的异常延迟,例如应用启动缓慢等。通过识别这些延迟问题,跟踪器可帮助智能手机OEM厂商优化系统,提升整体用户体验。

此功能可确保智能手机能够高速流畅地运行各种AI应用和日常任务,例如打开相机、在相册中查找之前度假时拍摄的照片等。

4. UFS分区(ZUFS):

想象一下,当您在旅行前收拾行李时,您的行李箱被整齐地划分为三个部分,分别用于放置袜子、衬衫和裤子,通过这种方式,您可以更快地找到所需物品。

美光的UFS分区(ZUFS)功能以类似方式组织智能手机内的数据。ZUFS将具有相似I/O特性的数据集中存放到UFS设备内的特定区域中,能够尽可能减少数据搜索时间,从而提高读/写效率。

这种简化的数据检索方式可确保系统响应更快、更流畅,就像在行李箱中取出预先放好的袜子一样。

传统数据放置方式与分区数据放置方式的对比

智能加速:面向未来的创新

美光移动业务部门专注于提供先进的NAND闪存解决方案,并提供针对旗舰智能手机设计的定制功能。

这些创新旨在加速边缘设备上的AI应用。通过与客户及生态系统伙伴合作,美光正在调整其产品和技术路线图,以便与AI及边缘计算的未来趋势保持一致。

这种合作可确保未来的移动设备能够处理日益复杂的AI任务,以及数据密集型应用。G9 NAND以及众多新的固件功能正是美光致力于创新的例证。

在线留言询价

美光®助力高性能计算新前沿

美光的智能制造:AI技术在企业中的应用

- 一周热料

- 紧缺物料秒杀

| 型号 | 品牌 | 询价 |

|---|---|---|

| BD71847AMWV-E2 | ROHM Semiconductor | |

| RB751G-40T2R | ROHM Semiconductor | |

| MC33074DR2G | onsemi | |

| TL431ACLPR | Texas Instruments | |

| CDZVT2R20B | ROHM Semiconductor |

| 型号 | 品牌 | 抢购 |

|---|---|---|

| ESR03EZPJ151 | ROHM Semiconductor | |

| IPZ40N04S5L4R8ATMA1 | Infineon Technologies | |

| TPS63050YFFR | Texas Instruments | |

| BP3621 | ROHM Semiconductor | |

| BU33JA2MNVX-CTL | ROHM Semiconductor | |

| STM32F429IGT6 | STMicroelectronics |

AMEYA360公众号二维码

识别二维码,即可关注

请输入下方图片中的验证码: